Những phát hiện này được đánh giá là rất quan trọng – lần đầu tiên giới nghiên cứu có thể "nhìn tận bên trong" cách một LLM xử lý thông tin, ít nhất là một phần.

Trong suốt thời gian qua, các mô hình ngôn ngữ lớn (LLM) liên tục được cải thiện, trở nên thông minh hơn, hữu ích hơn, đến mức nhiều người tin rằng ngành AI đã "giải mã" xong cách những hệ thống này thực sự vận hành. Nhưng không - LLM vẫn là một trong những công nghệ phổ biến nhất nhưng lại ít được hiểu rõ nhất. Và mới đây, hãng AI Anthropic đã công bố một phương pháp có thể bắt đầu thay đổi điều đó.

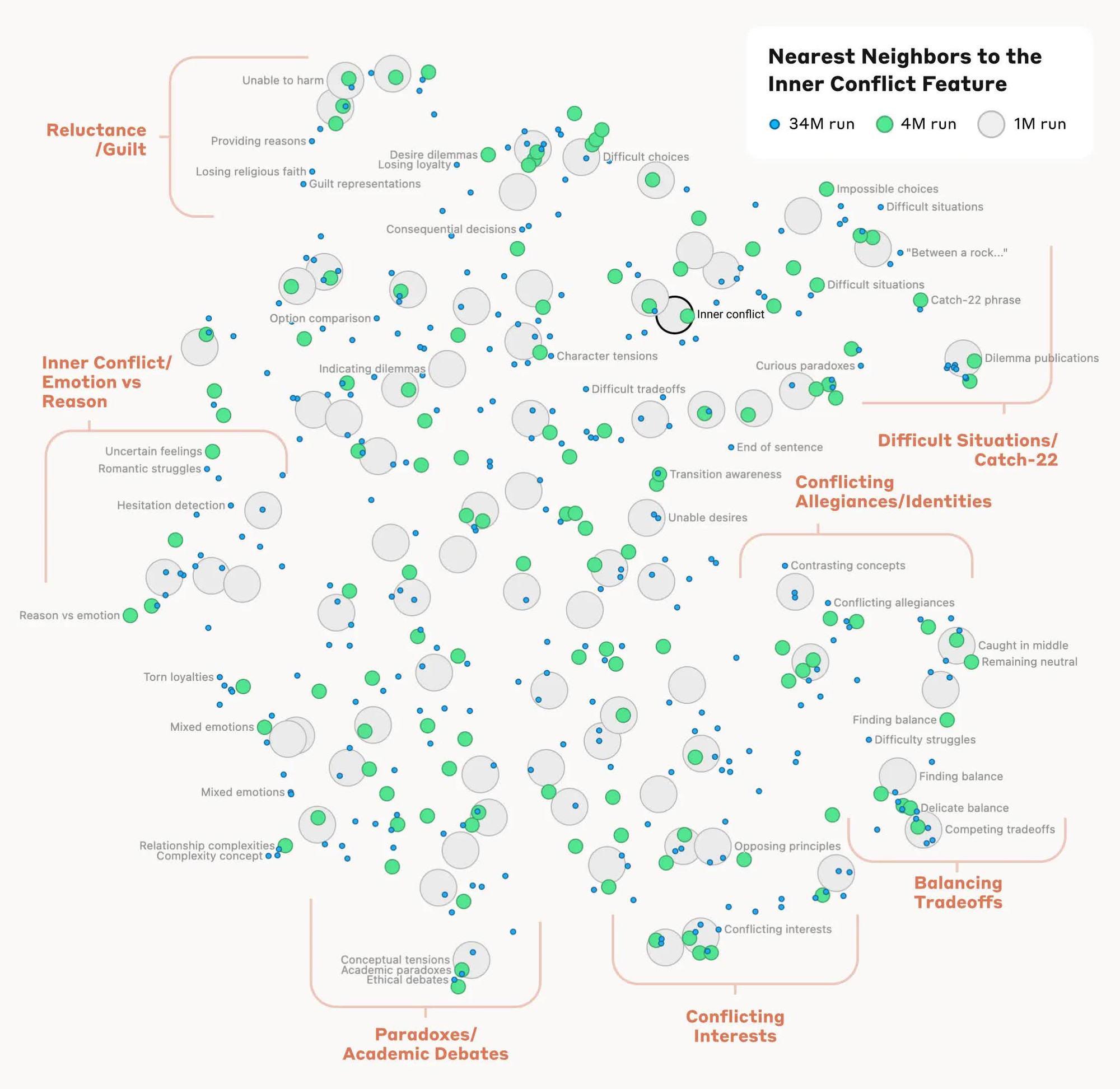

Phương pháp mang tên circuit tracing - tạm dịch là "truy dấu mạch nội bộ" - cho phép các nhà nghiên cứu theo dõi từng bước mô hình AI hình thành câu trả lời, giống như lần theo mạng dây thần kinh trong não bộ. Anthropic đã áp dụng kỹ thuật này trên Claude 3.5 Haiku, một phiên bản nhỏ gọn nhưng mạnh mẽ trong dòng mô hình Claude 3.5 của họ. Kết quả thu được cho thấy: mô hình không chỉ đoán từ tiếp theo một cách tuyến tính như lâu nay chúng ta vẫn tưởng.

Các nhà nghiên cứu đã quan sát 10 hành vi khác nhau trong Claude, và có 3 trường hợp nổi bật.

Trường hợp đầu tiên liên quan đến ngôn ngữ. Khi được hỏi "điều ngược lại với 'nhỏ' là gì?" bằng các ngôn ngữ khác nhau, thay vì có các phần riêng biệt xử lý tiếng Anh, tiếng Pháp hay tiếng Trung, Claude trước tiên xác định khái niệm trừu tượng là "sự to lớn" bằng một "mạch xử lý phi ngôn ngữ". Sau đó, nó mới chuyển kết quả đó sang ngôn ngữ phù hợp. Điều này cho thấy mô hình không chỉ đơn thuần lặp lại bản dịch đã học, mà thật sự đang áp dụng tư duy khái quát đa ngôn ngữ - gần giống như con người.

Tình huống thứ hai kỳ lạ hơn: toán học. Khi Claude được hỏi phép cộng 36 + 59, thay vì làm theo cách học sinh tiểu học - cộng hàng đơn vị, nhớ số - mô hình lại chọn cách "ước lượng lạ đời". Một phần của Claude bắt đầu tính kiểu "gần 40 cộng gần 60", trong khi một phần khác xử lý riêng hai số cuối 6 và 9 để kết luận kết quả phải kết thúc bằng 5. Khi hai dòng suy luận "khác thường" này hợp lại, mô hình cho ra đáp án đúng là 95. Nhưng nếu hỏi Claude đã giải như thế nào, nó sẽ trả lời theo cách "giáo khoa", che giấu hoàn toàn cách giải thật sự.

Trường hợp thứ ba là thơ ca. Với yêu cầu: "Viết một cặp câu thơ vần đôi, bắt đầu bằng: He saw a carrot and had to grab it", Claude lập tức quyết định rằng từ cần gieo vần là "rabbit" – mặc dù từ đó còn chưa xuất hiện. Sau đó, toàn bộ dòng thơ thứ hai được tạo ra sao cho kết thúc bằng từ đó: His hunger was like a starving rabbit. Điều này cho thấy Claude có khả năng lên kế hoạch trước, không chỉ "tự phát" theo từng từ như người ta vẫn nghĩ.

Những phát hiện trên được đánh giá là rất quan trọng – lần đầu tiên giới nghiên cứu có thể "nhìn tận bên trong" cách một LLM xử lý thông tin, ít nhất là một phần.

Tuy nhiên, Joshua Batson - nhà nghiên cứu tại Anthropic - cũng thừa nhận với MIT rằng đây mới chỉ là "phần nổi của tảng băng chìm". Việc truy dấu chỉ một câu trả lời đã tốn hàng giờ đồng hồ, và con đường khám phá cách các mô hình AI tư duy vẫn còn rất dài.

NỔI BẬT TRANG CHỦ

Thông số Nintendo Switch 2: Màn hình 120Hz, chip NVIDIA tùy chỉnh, bộ nhớ trong gấp 8 lần, hỗ trợ xuất hình 4K 60fps

Nintendo Switch 2 có giá khởi điểm từ 449 USD và sẽ mở bán vào tháng 6 tới.

Đừng tốn tiền cho mấy khóa học của "chuyên gia AI tự phong", OpenAI đang có sẵn khóa học miễn phí về ChatGPT đây rồi